Java 21でついに正式導入された仮想スレッド(Virtual Threads)について、これまでの開発体験を振り返りながら詳しくお話しします。私は長年、Javaを用いたサーバーサイド開発に携わってきましたが、並行処理には常に悩まされてきました。

スレッドプールの最適化に数日を費やしたり、原因不明のメモリ不足に頭を抱えたりした経験は一度や二度ではありません。この記事を読めば、従来のスレッドモデルが抱えていた限界がどのように解消され、複雑な非同期コードからいかに解放されるかが明確になります。

皆さんは「リクエストが増えるとサーバーが重くなるのは仕方ない」と諦めてはいませんか。実は、その不満の正体はアプリケーションのロジックではなく、OSスレッドというリソースの枯渇にある場合がほとんどです。

この本質的な問題を放置すると、どれだけ高性能なサーバーを用意しても、ハードウェアの性能を使い切ることはできません。仮想スレッドという強力な武器を手に入れて、同期プログラミングの書きやすさと圧倒的なスケーラビリティを両立させる方法をステップバイステップで見ていきましょう。

Java 21の仮想スレッドとは何かを、まず全体像から理解する

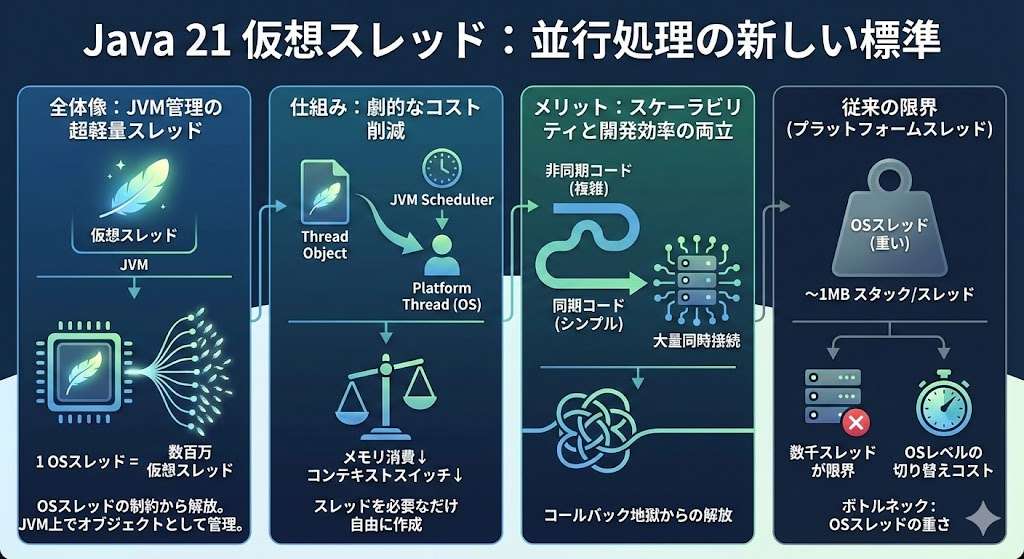

仮想スレッドは、Javaの実行環境(JVM)が管理する非常に軽量なスレッドです。従来のJavaにおいて、スレッドはオペレーティングシステム(OS)のスレッドと1対1で結びついていました。

しかし、仮想スレッドはこの制約を取り払い、1つのOSスレッド上で数万、あるいは数百万ものスレッドを走らせることを可能にします。これはJavaの並行処理の歴史において、もっとも大きな転換点といっても過言ではありません。

これまで並列度を高めようとすると、メモリ消費量やコンテキストスイッチのコストが壁になっていました。仮想スレッドは、スレッド自体をJVM上の「オブジェクト」として扱うことで、これらのコストを劇的に抑えています。

つまり、開発者はスレッドが貴重な資源であることを忘れて、必要な分だけ自由にスレッドを作成できるようになったのです。このパラダイムシフトが、モダンなJava開発における新しい標準となります。

そもそも仮想スレッドは何を解決する仕組みなのか

仮想スレッドは、スケーラビリティと開発効率のトレードオフを解決します。

これまでは、高いスケーラビリティを得るために、リアクティブプログラミングのような難解な非同期コードを書く必要がありました。

仮想スレッドを使えば、なじみのある「1リクエスト1スレッド」のシンプルな同期コードのまま、大量の同時接続をさばけるようになります。複雑なコールバック地獄から解放されることが、最大のメリットです。

従来のスレッドモデル(プラットフォームスレッド)の限界

従来のスレッドは、1つあたり約1MBのスタックメモリを消費していました。そのため、4GBのメモリを積んだサーバーでも、数千スレッドを作成するのが限界です。

また、OSレベルのコンテキストスイッチが発生するため、頻繁にスレッドを切り替えるとオーバーヘッドが無視できなくなります。この「OSスレッドの重さ」が、Javaアプリケーションの同時並行数を制限する大きなボトルネックでした。

なぜJava 21で仮想スレッドが本格導入されたのか

現代のサーバーアプリケーションには、かつてないほどの同時接続性能が求められています。マイクロサービス化が進み、1つのリクエストを処理するために複数のAPIやデータベースへアクセスする機会が増えました。

このような待ち時間が多い処理において、従来のスレッドモデルではスレッドがアイドル状態で放置され、貴重な計算資源が無駄になっていたのです。Javaが今後もエンタープライズ領域で生き残るためには、この非効率を解消する必要がありました。

仮想スレッドの導入背景には、Go言語のGoroutineやErlangの軽量プロセスといった成功例の影響もあります。他の言語が軽量スレッドによって高いスケーラビリティを実現する中、Javaも同様の、あるいはそれ以上の仕組みを取り込む必要がありました。

長年温められてきた「Project Loom」がJava 21でようやく形になったのは、堅牢さを維持しつつ現代のクラウドネイティブな環境に適応させるためだったのです。

高並行処理が当たり前になった現代のサーバー事情

現在のWebサービスでは、数万人のユーザーが同時にアクセスすることは珍しくありません。特にIoTやリアルタイム通知などの分野では、長時間コネクションを維持する処理が増えています。

OSスレッドを消費し続ける従来の手法では、こうした高並行な要求に応えることが物理的に不可能になっていました。仮想スレッドは、このような現代的な負荷パターンに対応するための必然的な進化です。

Project Loomが目指していた設計思想

Project Loomの根底には「コードの書きやすさを犠牲にせず、パフォーマンスを最大化する」という思想があります。既存のライブラリやデバッグ手法をそのまま使いつつ、スレッドのコストだけを下げることが目標でした。

つまり、新しいプログラミングモデルを学ぶ必要はなく、これまでの知識を活かしたまま、より高性能なシステムを構築できるように設計されているのです。

仮想スレッドの仕組みをイメージで理解する

仮想スレッドの仕組みを理解するコツは「仕事をする人」と「机」の関係で考えることです。OSスレッドが「作業机」だとすると、仮想スレッドはそこに座って仕事をする「タスク」のようなもの。

従来のJavaでは1つの机に1人しか座れず、その人が休憩(I/O待ち)している間も机は占有されていました。仮想スレッドでは、誰かが休憩に入ると、即座に別の人がその机を使って作業を再開します。

この仕組みにより、少数の「作業机(OSスレッド)」を使い回して、膨大な数の「タスク(仮想スレッド)」を効率よく片付けることが可能です。

この「机の貸し借り」をJVMが自動で行ってくれるため、開発者は裏側の複雑な制御を意識する必要がありません。メモリ上にはタスクのデータだけが保持され、実際にCPUを動かすときだけOSスレッドへ割り当てられるのです。

OSスレッドと仮想スレッドの関係

仮想スレッドは、プラットフォームスレッド(OSスレッド)の上で実行されます。1つのプラットフォームスレッドが、複数の仮想スレッドを次々と切り替えて処理する「多対多」のマッピング構造です。

仮想スレッドがI/O操作などでブロックされると、JVMはそれをプラットフォームスレッドから切り離します。空いたプラットフォームスレッドは、すぐに別の仮想スレッドの実行へ回される仕組みです。

キャリアスレッドとスケジューリングの考え方

仮想スレッドを実際に実行しているプラットフォームスレッドのことを「キャリアスレッド」と呼びます。JVM内のスケジューラが、どの仮想スレッドをどのキャリアスレッドに乗せるかを管理しています。

このスケジューリングは先取り式ではなく、協力的なマルチタスクに近い挙動をします。ブロッキング操作が発生した瞬間に制御権が移るため、効率的なリソース活用が実現できるのです。

仮想スレッドを使うと何が変わるのか(メリット)

最大のメリットは、スレッドプールの管理という苦行から解放されることです。これまでは「スレッドを何個用意すれば最適か」という難しい計算に追われていました。

仮想スレッドなら、タスクごとにスレッドを使い捨てにしても問題ありません。ExecutorServiceでスレッド数を固定する必要がなくなり、コードは劇的にシンプルになります。この解放感は、一度味わうと元には戻れません。

また、デバッグやプロファイリングが容易になる点も見逃せません。非同期ライブラリを使うと、スタックトレースが途切れてしまい原因究明が困難になることがよくありました。

仮想スレッドは「同期的な書き方」を維持するため、エラー時のスタックトレースが上から下まで綺麗に繋がります。開発者の生産性を維持したまま、システムの限界性能を引き上げられるのは非常に強力な利点です。

スレッド数を気にせず書けるコードになる

仮想スレッドを使えば、1,000,000個のスレッドを同時に立ち上げることも現実的です。これまでは「スレッドは高価なもの」という常識があり、再利用するためのプール管理が必須でした。

しかし、これからは必要な時に必要なだけ生成し、終わったら捨てるという使い方が基本になります。リソース制約を気にせず、ロジックの記述に集中できる環境が整いました。

非同期処理をシンプルな同期コードで表現できる

CompletableFutureやリアクティブ系のライブラリを駆使していた処理が、ただの命令形コードで書けるようになります。

try (var executor = Executors.newVirtualThreadPerTaskExecutor()) {

var future1 = executor.submit(() -> fetchData(1));

var future2 = executor.submit(() -> fetchData(2));

// get()でブロックしてもOSスレッドは無駄にならない

var result = future1.get() + future2.get();

}このように、見た目はブロッキングでも、裏側では非ブロッキングに動作します。

サーバーアプリケーションのスケーラビリティ向上

スループットの向上が期待できる点も重要です。特に、データベースへのクエリ発行や外部APIの呼び出しなど、待ち時間が多いアプリケーションで真価を発揮します。

スレッドがブロックされている間のリソース消費が極小化されるため、同じスペックのサーバーでもより多くのリクエストを同時に処理できるようになります。これはインフラコストの削減にも直結する大きなメリットです。

仮想スレッドにも注意点はある

魔法のような仮想スレッドですが、何でも解決する銀の弾丸ではありません。最も注意すべきなのは、CPUに負荷をかけ続ける「CPUバウンド」な処理です。

仮想スレッドは、あくまで「待ち時間」を有効活用するための仕組み。計算処理そのものを速くするわけではないため、複雑な計算を大量の仮想スレッドで回すと、逆にコンテキストスイッチのオーバーヘッドで遅くなる可能性があります。

また、既存のコードとの相性にも気を配る必要があります。例えば、synchronizedブロック内でブロッキングI/Oを行うと、キャリアスレッドが固定(ピン留め)されてしまい、他の仮想スレッドが動けなくなる現象が発生します。

これを「Pinning」と呼びます。仮想スレッドの恩恵をフルに受けるには、ReentrantLockへの書き換えを検討するなど、従来の書き方を少し見直す工夫が求められます。

すべての処理が高速になるわけではない理由

仮想スレッドは「並行性」を高めるものであり、単一タスクの「実行速度」を上げるものではありません。

むしろ、スレッドの管理オーバーヘッドがわずかに追加されるため、単一の処理時間はプラットフォームスレッドより微増する場合もあります。多くのタスクを「同時に」効率よく回すことが目的であることを忘れてはいけません。用途を間違えると、期待した効果は得られないでしょう。

ブロッキングI/Oと仮想スレッドの相性

仮想スレッドはブロッキングI/Oと非常に相性が良いです。標準ライブラリの多くが、仮想スレッドで実行された場合に「スレッドをブロックせずに譲り合う」ように修正されています。

しかし、JNIを介したネイティブコード内でのブロックや、一部の古いドライバではこの挙動が機能しない場合があります。自分が使っているライブラリが仮想スレッドに適応しているか、確認する習慣が必要です。

既存ライブラリ利用時に意識すべきポイント

ThreadLocalの多用には注意が必要です。仮想スレッドは大量に生成されるため、各スレッドで巨大なオブジェクトをThreadLocalに保持すると、あっという間にメモリを食いつぶします。

また、前述したsynchronizedによるピン留め問題もあります。特にJDBCドライバなどの古いライブラリを使用する場合は、予期せぬボトルネックが発生しないか慎重に検証しなければなりません。

仮想スレッドはどんな場面で使うべきか

仮想スレッドが最も輝くのは、Web APIサーバーやマイクロサービスのような、ネットワークI/Oが中心となるアプリケーションです。1つのリクエストに対して複数の外部サービスを呼び出し、そのレスポンスを待つような処理には最適といえます。

これまでなら非同期APIを組み合わせて複雑なチェーンを書いていた箇所を、素直なforループや逐次処理で記述できるようになります。

一方で、大量の数値計算や画像処理といった、CPUをフル回転させるタスクには向いていません。こうした処理には、従来どおりスレッド数を制限したプラットフォームスレッドのプールを使うべきです。

また、非常に短い寿命のタスクを大量に発行する場合も、スレッド生成のコストが無視できなくなる可能性があります。自分のアプリケーションが「待っている時間」が長いのか「計算している時間」が長いのかを見極めることが肝心です。

Webアプリ・APIサーバーでの典型的なユースケース

Spring Bootなどのフレームワークと組み合わせることで、リクエスト処理全体を仮想スレッド化できます。これにより、スレッドプールの枯渇を恐れることなく、同期的なプログラミングモデルで高スループットなサービスを構築可能です。

特に、呼び出し先のマイクロサービスが低速な場合や、同時接続数が不規則に変動する環境で、仮想スレッドの安定性が際立ちます。

逆に従来スレッドや非同期が向いているケース

ビデオのエンコードや暗号化処理などのCPUヘビーなタスクは、プラットフォームスレッドのほうが適しています。こうした処理では、スレッドを切り替えるメリットがなく、むしろコア数に合わせたスレッドプールで愚直に計算させるほうが高速です。

また、すでにリアクティブスタック(Project Reactorなど)で完璧に構築され、安定稼働しているシステムを無理に仮想スレッドへ移行する必要もありません。

Java 21で仮想スレッドを使い始めるための最低限の知識

仮想スレッドを使い始めるのは驚くほど簡単です。基本的には、Executorsクラスに追加された新しいメソッドを呼び出すだけ。既存のExecutorServiceインターフェースを実装しているため、タスクの投入方法はこれまでと変わりません。

Executors.newVirtualThreadPerTaskExecutor()を使えば、タスクごとに新しい仮想スレッドを割り当てるエグゼキューターが手に入ります。

ただし、既存コードの移行には少しだけ戦略が必要です。すべてのプラットフォームスレッドを一度に仮想スレッドへ置き換えるのではなく、まずはI/O待ちが顕著なボトルネックから着手することをお勧めします。

また、スレッドプールの「最大数」で流量制御をしていた箇所は要注意です。仮想スレッドには実質的な上限がないため、セマフォ(Semaphore)などを使って明示的に同時実行数を制御する設計が必要になります。

Executorと仮想スレッドの基本的な使い方

仮想スレッドを直接生成するにはThread.ofVirtual().start(runnable)を使いますが、実務ではExecutorService経由で扱うのが一般的です。

try (var executor = Executors.newVirtualThreadPerTaskExecutor()) {

executor.submit(() -> {

// ここに処理を書く

System.out.println("Hello from Virtual Thread!");

});

}このように、try-with-resources構文を使うことで、すべてのタスクが完了するのを安全に待機できます。

既存コードをどう移行・併用するかの考え方

移行の第一歩は、スレッドプールの定義を仮想スレッド用に差し替えることです。しかし、前述の通り流量制限がなくなるため、接続先のデータベースや外部APIがパンクしないよう注意してください。

共有リソースへのアクセスを制限するには、スレッドプールに頼るのではなく、Semaphoreを活用するのがスマートなやり方です。新旧のスレッドモデルは共存可能なので、適材適所で使い分ける姿勢が大切です。

Javaエンジニアは仮想スレッドをどう学び、どう向き合うべきか

仮想スレッドはJavaの書き方を根本から変える可能性を秘めています。しかし、焦って本番環境のすべてを刷新する必要はありません。まずは、社内のツールや小規模なバッチ処理から導入し、その挙動を観察することから始めましょう。

従来のデバッグツールやモニタリングツールが仮想スレッドをどう表示するのか、自分の目で確かめることが最大の学習になります。

私自身、最初は「本当に同期コードで大丈夫なのか」と疑っていましたが、実際に使ってみるとそのシンプルさと性能のバランスに驚かされました。

仮想スレッドは単なる新機能ではなく、Javaが培ってきた「シンプルで堅牢」という美徳を取り戻すための原点回帰だと感じています。この技術をマスターすることは、今後10年のJava開発を生き抜くための必須スキルになるでしょう。

今すぐ本番投入すべきか、学習用途から始めるべきか

Java 21はLTS(長期サポート)版なので、本番投入の土壌は整っています。ただし、使用しているフレームワークやライブラリの対応状況を十分に確認してください。

例えば、Spring Boot 3.2以降であれば、設定一つで仮想スレッドを有効にできます。まずは検証環境で負荷試験を行い、これまでのチューニングパラメータがどう変化するかを確認した上で、段階的に導入を進めるのが賢明です。

仮想スレッドがJavaの設計思想に与える今後の影響

仮想スレッドの登場により、Javaは「非同期プログラミングの複雑さ」という呪縛から解き放たれました。今後は、構造化並行性(Structured Concurrency)やスコープ値(Scoped Values)といった、並行処理をより安全に扱うための機能がさらに充実していく予定です。Javaは、誰が書いても読みやすく、かつ最高のパフォーマンスを発揮できる言語へと進化し続けています。

Java 21の仮想スレッドを使いこなせるようになれば、あなたのコードはもっと自由でパワフルになります。まずは、手元のプロジェクトでnewVirtualThreadPerTaskExecutorを試してみてください。その一歩が、モダンなJavaエンジニアへの大きな転換点になるはずです。もし設定方法や具体的な移行プランで迷うことがあれば、いつでも相談してくださいね。